방사선 전문의조차 실제 엑스레이와 인공지능(AI)이 만든 ‘딥페이크’ 사진을 구분하기 어려운 것으로 나타났다.

미국 마운트 시나이 아이칸 의과대학 연구팀은 미국, 프랑스, 독일, 터키, 영국, 아랍에미리트 등 6개국 12개 기관의 영상의학과 전문의 17명을 대상으로 연구를 진행했다. 참여자들의 경력은 신입부터 40년 경력의 전문가까지 다양했으며, 실제 엑스레이와 AI가 생성한 사진 등 총 264장이 분석에 사용됐다.

연구 결과, 방사선 전문의들은 가짜 사진이 포함됐다는 사실을 모른 상태에서 AI 생성 엑스레이를 식별한 비율이 41%에 그쳤다. 합성 사진이 포함됐다는 사실을 사전에 인지한 경우, 진짜와 가짜 사진을 구분하는 정확도는 평균 75%로 높아졌다.

전문의 개인별 편차도 컸다. ChatGPT가 생성한 사진을 정확히 구분한 비율은 58%에서 92%까지 다양하게 나타났으며, 방사선 전문의의 경력과 판별 능력 사이에는 뚜렷한 연관성이 없는 것으로 밝혀졌다. 다만 근골격계 전문의는 다른 세부 전공보다 상대적으로 높은 식별 정확도를 보였다.

AI 역시 한계를 보였다. GPT-4o, GPT-5, Gemini 2.5 Pro, Llama 4 Maverick 등 멀티모달 대규모 언어 모델(LLM)의 정확도는 57~85% 수준에 머물렀다. 딥페이크 사진을 생성하는 데 활용된 GPT-4o조차 모든 사진을 식별하지는 못했다. 이는 생성 모델조차 자신이 만든 이미지를 완벽히 구분하지 못한다는 점을 보여준다.

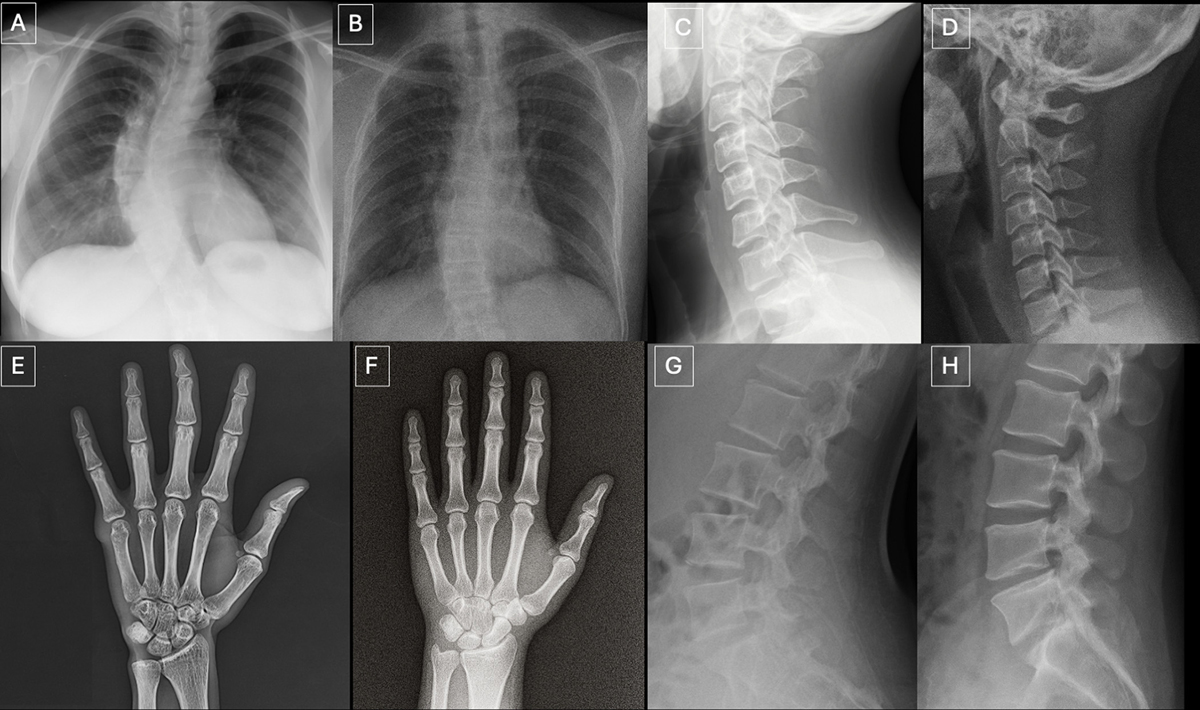

연구팀은 딥페이크 엑스레이 사진의 특징도 제시했다. 실제 엑스레이 사진과 달리 뼈가 지나치게 매끄럽고, 척추가 비정상적으로 곧으며, 폐가 과도하게 대칭적인 등 ‘지나치게 완벽한’ 형태를 보이는 경우가 많다는 것이다. 골절 역시 한쪽 면에만 국한되거나 지나치게 깨끗한 형태로 나타나는 경향이 있었다. 연구 주 저자 마운트 시나이 아이칸 의과대학 미카엘 토르드즈만 박사는 “이번 연구는 딥페이크 엑스레이 사진이 인공지능으로 생성된 사진임을 인지하고 있는 전문가조차 속일 수 있을 만큼 현실적이라는 것을 보여준다”며 “이러한 발전의 다음 단계는 CT, MRI가 될 수 있다”고 말했다.

이 같은 신기술은 의료 현장에 새로운 위험을 초래할 수 있다. 예를 들어 조작된 골절 사진이 실제와 구별되지 않을 경우 보험 사기나 법적 분쟁에 악용될 수 있다. 또한 해커가 병원 네트워크에 접근해 합성 사진을 의료 데이터 속에 삽입할 경우, 진단 오류를 유발하거나 의료 기록의 신뢰성을 훼손하는 등 임상적 혼란을 일으킬 수 있다. 이에 연구팀은 보이지 않는 워터마크 삽입, 촬영 시점 정보를 포함한 암호화 서명 등 영상 진위를 검증할 수 있는 디지털 기술 대응이 필요하다고 설명했다.

한편, 이번 연구 결과는 영상의학 분야 국제 학술지인 ‘Radiology’에 지난 24일 게재됐다.

미국 마운트 시나이 아이칸 의과대학 연구팀은 미국, 프랑스, 독일, 터키, 영국, 아랍에미리트 등 6개국 12개 기관의 영상의학과 전문의 17명을 대상으로 연구를 진행했다. 참여자들의 경력은 신입부터 40년 경력의 전문가까지 다양했으며, 실제 엑스레이와 AI가 생성한 사진 등 총 264장이 분석에 사용됐다.

연구 결과, 방사선 전문의들은 가짜 사진이 포함됐다는 사실을 모른 상태에서 AI 생성 엑스레이를 식별한 비율이 41%에 그쳤다. 합성 사진이 포함됐다는 사실을 사전에 인지한 경우, 진짜와 가짜 사진을 구분하는 정확도는 평균 75%로 높아졌다.

전문의 개인별 편차도 컸다. ChatGPT가 생성한 사진을 정확히 구분한 비율은 58%에서 92%까지 다양하게 나타났으며, 방사선 전문의의 경력과 판별 능력 사이에는 뚜렷한 연관성이 없는 것으로 밝혀졌다. 다만 근골격계 전문의는 다른 세부 전공보다 상대적으로 높은 식별 정확도를 보였다.

AI 역시 한계를 보였다. GPT-4o, GPT-5, Gemini 2.5 Pro, Llama 4 Maverick 등 멀티모달 대규모 언어 모델(LLM)의 정확도는 57~85% 수준에 머물렀다. 딥페이크 사진을 생성하는 데 활용된 GPT-4o조차 모든 사진을 식별하지는 못했다. 이는 생성 모델조차 자신이 만든 이미지를 완벽히 구분하지 못한다는 점을 보여준다.

연구팀은 딥페이크 엑스레이 사진의 특징도 제시했다. 실제 엑스레이 사진과 달리 뼈가 지나치게 매끄럽고, 척추가 비정상적으로 곧으며, 폐가 과도하게 대칭적인 등 ‘지나치게 완벽한’ 형태를 보이는 경우가 많다는 것이다. 골절 역시 한쪽 면에만 국한되거나 지나치게 깨끗한 형태로 나타나는 경향이 있었다. 연구 주 저자 마운트 시나이 아이칸 의과대학 미카엘 토르드즈만 박사는 “이번 연구는 딥페이크 엑스레이 사진이 인공지능으로 생성된 사진임을 인지하고 있는 전문가조차 속일 수 있을 만큼 현실적이라는 것을 보여준다”며 “이러한 발전의 다음 단계는 CT, MRI가 될 수 있다”고 말했다.

이 같은 신기술은 의료 현장에 새로운 위험을 초래할 수 있다. 예를 들어 조작된 골절 사진이 실제와 구별되지 않을 경우 보험 사기나 법적 분쟁에 악용될 수 있다. 또한 해커가 병원 네트워크에 접근해 합성 사진을 의료 데이터 속에 삽입할 경우, 진단 오류를 유발하거나 의료 기록의 신뢰성을 훼손하는 등 임상적 혼란을 일으킬 수 있다. 이에 연구팀은 보이지 않는 워터마크 삽입, 촬영 시점 정보를 포함한 암호화 서명 등 영상 진위를 검증할 수 있는 디지털 기술 대응이 필요하다고 설명했다.

한편, 이번 연구 결과는 영상의학 분야 국제 학술지인 ‘Radiology’에 지난 24일 게재됐다.

이 기사와 관련기사